Pythonで体験する 深層学習 - Caffe,Theano,Chainer,TensorFlow -

Pythonベースの深層学習フレームワークであるCaffe,Theano,Chainer,TensorFlowを紹介した。

- 発行年月日

- 2016/08/18

- 判型

- A5

- ページ数

- 288ページ

- ISBN

- 978-4-339-02851-5

- 内容紹介

- 目次

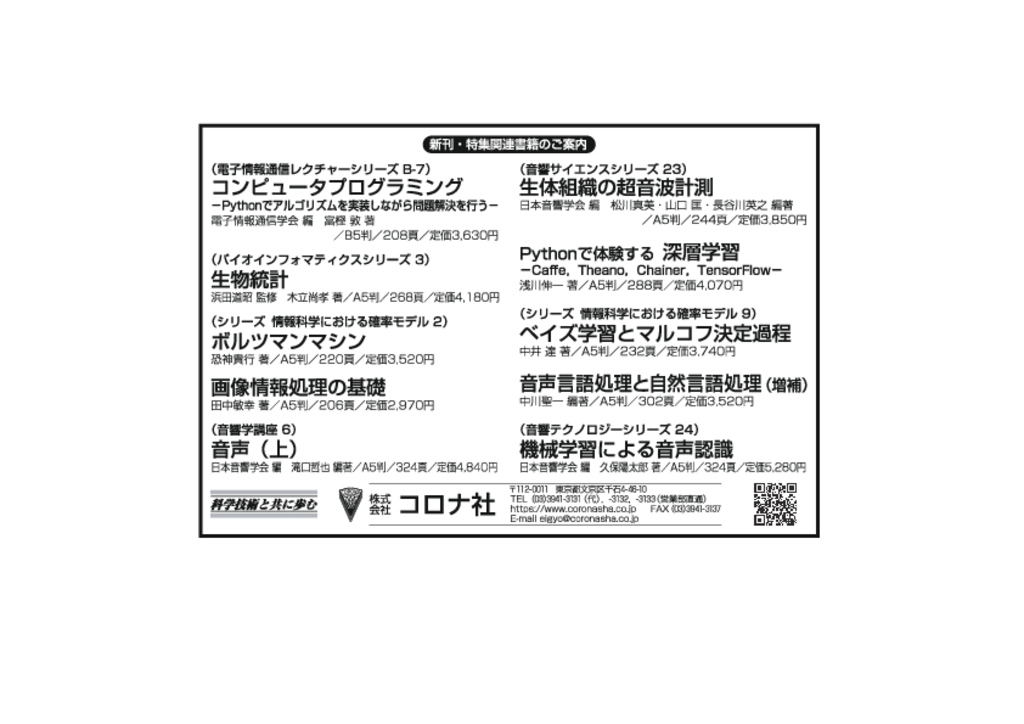

- 広告掲載情報

Pythonベースの深層学習フレームワークであるCaffe,Theano,Chainer,TensorFlowを紹介し,実際に動作するモデルとその理論であるCNNとLSTMを画像認識と自然言語処理を題材にして解説。

1. はじめに

1.1 深層学習の現状

1.2 日常の中の深層学習

1.3 実践による理解

1.4 本書で使用した環境

1.5 必要な予備知識

1.6 取り上げた話題

1.7 理論および技術の展開

1.8 本書で用いた処理系,ツール,パッケージ

1.8.1 Caffe

1.8.2 Chainer

1.8.3 TensorFlow

1.8.4 Theano

1.9 本書の構成

1.10 数学表記

章末問題

2. Python

2.1 動作環境

2.2 Python2かPython3か

2.3 参考情報

2.4 コーディングスタイル

2.5 PythonとNumPy略説

2.5.1 基本データ型

2.5.2 コンテナ

2.5.3 関数

2.5.4 クラス

2.5.5 NumPy

2.6 Pythonによる深層学習フレームワーク

2.6.1 Caffe

2.6.2 Theano

2.6.3 Chainer

2.6.4 LSTMとゲート付き再帰ユニット

2.6.5 TensorFlow

2.7 scikit-learn

章末問題

3. ニューラルネットワークの基盤となる考え方

3.1 ニューロンモデル

3.1.1 生物学的ニューロンモデル

3.1.2 人工ニューロンのモデル

3.2 パーセプトロン

3.3 バックプロパゲーション

3.3.1 バックプロパゲーションの問題点

3.3.2 中間層の意味

3.4 多層化

3.5 リカレントニューラルネットワーク

3.5.1 単純再帰型ニューラルネットワーク

3.5.2 リカレントニューラルネットワークの学習

3.5.3 系列予測と系列生成

章末問題

4. 深層学習理論

4.1 畳み込みニューラルネットワーク

4.1.1 LeNet

4.1.2 一般化行列積(GEMM)

4.1.3 AlexNet

4.1.4 畳み込みニューラルネットワークの諸技法

4.2 LSTM

4.2.1 CECの呪い

4.2.2 勾配消失問題,勾配爆発問題

4.2.3 ゲート付き再帰ユニット

4.2.4 双方向再帰モデル:BRNN

4.2.5 LSTMの変種

4.3 確率的勾配降下法

4.3.1 勾配降下法:GD

4.3.2 ニュートン法:2GD

4.3.3 確率的勾配降下法:SGD

4.3.4 2階確率的勾配降下法:2SGD

4.3.5 AdaGrad

4.3.6 AdaDelta

4.3.7 Adam

4.3.8 RMSprop

4.3.9 Nesterov

章末問題

5. 深層学習の現在

5.1 GoogLeNet

5.2 VGG

5.3 SPP

5.4 ネットワーク・イン・ネットワーク

5.5 残差ネットResNet

5.6 画像からの領域切り出し

5.7 R-CNN

5.8 FastR-CNN

5.9 FasterR-CNN

5.10 リカレントニューラルネットワーク言語モデル

5.10.1 従来法

5.10.2 リカレントニューラルネットワーク言語モデル上の意味空間

5.10.3 スキップグラム(word2vec)

5.10.4 ニューラルネットワーク機械翻訳

5.10.5 ニューラル言語モデル

5.10.6 注意の導入

5.10.7 プログラムコード生成

5.10.8 ニューラルチューリングマシン

5.10.9 構文解析

5.10.10 音声認識

5.10.11 リカレントニューラルネットワーク関係の実装サイト

6. 深層学習の展開

6.1 ニューラル画像脚注づけ

6.1.1 MSCOCO

6.1.2 グーグルの方法

6.1.3 スタンフォード大の方法

6.1.4 UCバークリー校の方法

6.1.5 ニューラル画像脚注づけへ注意の導入

6.2 強化学習によるゲームAI

6.2.1 ボードゲーム

6.2.2 強化学習

6.2.3 TD学習

6.2.4 TDバックギャモン

6.2.5 Q学習

6.2.6 ディープQ学習ネットワーク

6.2.7 ロボット制御

6.3 メモリネットワーク

6.4 強化学習ニューラルチューリングマシン

6.5 顔情報処理

6.5.1 従来法

6.5.2 深層学習による顔情報処理

章末問題

7. おわりに

7.1 工学と哲学の狭間にある尊厳

7.2 変容する価値と社会

章末問題

付録

A.1 画像処理基本と用語

A.1.1 SIFT

A.1.2 HOG

A.1.3 Bag-of-Words

A.1.4 スーパーピクセルズ

A.1.5 グラフ理論による領域分割

A.1.6 MCG

A.2 ミコロフのリカレントニューラルネットワーク言語モデル

A.3 自然言語処理における指標

A.3.1 TD-IDF

A.3.2 パッケージ

A.3.3 BLEU

A.3.4 F-値

A.3.5 パープレキシティ

A.3.6 METEOR

A.3.7 ROUGE-L

A.3.8 CIDEr

A.3.9 バックオフ平準化

A.3.10 トークナイザ

A.3.11 WER

A.4 ヴィオラ・ジョーンズ法による顔領域の切り出し

引用文献

索引

-

掲載日:2022/05/02